Künstliche Neuronale Netze – Das Gehirn hinter der KI

Künstliche neuronale Netze (KNN) haben wir ja bereits in unserem Bericht über das Deep Learning erwähnt. Heute schauen wir uns diesen Bereich der Neuroinformatik genauer an! Das Thema künstliche neuronale Netze (englisch *artificial neural network*, ANN) ist für uns besonders spannend, da auf ihm u. a. Teildisziplinen der Künstliche Intelligenzund des Maschinellen Lernens basieren. Wie so Vieles hat das wissenschaftliche Forschungsgebiet seinen Ursprung in der Biologie: Bei den natürlichen neuronalen Netzen.

Von der Natur abgeschaut: Wie ist ein KNN aufgebaut?

Unser Gehirn funktioniert durch Verbindungen zwischen den Nervenzellen (Neuronen). Dabei ist ein Neuron eine Zelle, bei der viele Signale an mehreren Eingangskanälen ankommen. Sobald diese Eingangssignale einen bestimmten Wert, den sog. Schwellwert, überschreiten, gibt das Neuron an einem Ausgangskanal ein Signal aus. In unserem Gehirn befinden sich unglaublich viele einzelne Neuronen.

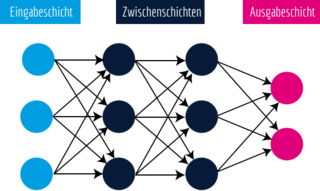

Im Computer werden diese Strukturen der Übersichtlichkeit halber als Schichten, also linear, dargestellt.

Signale kommen – hier natürlich in Form von Zahlen – an und der Computer erkennt: Hier haben wir es mit einer bestimmten Farbe, einer bestimmten Klasse o. ä. zu tun. Für jeden Eingangskanal eines Neurons gibt es eine bestimmte Gewichtung. Diese Wichtigkeit wird erkannt und mit in die Berechnung einbezogen.

Der Schwellwert dagegen bestimmt, wie viel Input ein bestimmtes Neuron benötigt, bis es etwas ausgibt. Dieser Punkt des Überschreitens kann für jedes Neuron individuell bestimmt werden.

Zusammenfassend ist es die Aufgabe eines einzelnen Neurons bzw. einer Neuronenschicht, aus vielen Eingabewerten wenige Ausgabewerte zu machen. Dieser Prozess kann “aufeinandergestapelt” werden und mehrere Schichten ergeben ein künstliches neuronales Netz.

Je höher man dabei “stapelt”, desto komplexer ist das, worauf das Neuron im Eingabebereich reagiert. In der letzten Ebene bleibt schließlich nur noch das, worauf das Netz “trainiert” wurde, übrig.

Wie lernt das KNN?

Man kann künstliche neuronale Netze trainieren, denn sie sind nichts anderes als mathematische Funktionen. Durch Veränderung der Parameter Schwellenwert und/oder Gewichtung ist es möglich, die Eingangskanäle der einzelnen Neuronen auf etwas Bestimmtes hin zu sensibilisieren.

Dazu benötigt man möglichst viele Trainingsbeispiele, aus welchen die KNN lernen können. Welche Neuronen haben in vergangenen Beispielen/Versuchen am meisten dazu beigetragen, dass die falsche Klasse aktiviert wurde? Welche Neuronen müssten mehr aktiv sein, damit die richtige Klasse aktiviert wird?

Die einzelnen Parameter sind dann irgendwann so eingestellt, dass die Vorhersagen des Netzwerkes möglichst oft richtig sind.

Die Anwendungsbereiche künstlicher neuronaler Netze

Das Gebiet der KNN steckt noch in den Kinderschuhen, und es gibt noch viel zu erforschen. Bereits jetzt kommen sie in der Bild- oder Texterkennung zum Einsatz, können aber auch in Frühwarnsystemen oder Bereichen der medizinischen Diagnostik dazu beitragen, Leben zu retten. Wir können also gespannt sein, welche Erkenntnisse die künstlichen neuronalen Netze in Zukunft für uns bereithalten.

Ihre Fragen zu allen Themen rund um Maschinelles Lernen, KI oder KNN beantworten wir gerne! Kontaktieren Sie uns jederzeit unter https://www.meta-level.de/kontakt/.